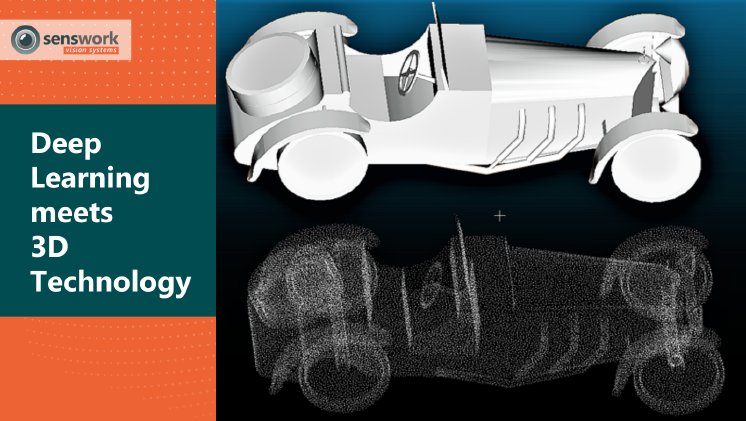

Die beiden häufigsten Darstellungen für Bilder sind Punktwolken und Netze. Auf einem regelmäßigen Raster sind jedoch weder Punktwolken noch Netze definiert. Aufgrund ihres unregelmäßigen Formats können tiefe neuronale Netze derzeit nicht direkt verwendet werden.

Es gibt zwei gängige Methoden, um diese 3D-Daten zu analysieren:

1. Prozesse, die zunächst unregelmäßige Daten in regelmäßige Strukturen wie 3D-Volumenraster (durch Quantisierung) oder Bilder mit mehreren Ansichten (durch Rendering oder Projektion) umwandeln und dann vorhandene Architekturen darauf anwenden.

2. Prozesse, die unregelmäßige Daten wie Punktwolken direkt ausgleichen. Diese Architekturen sind so konzipiert, dass sie die besonderen Eigenschaften der eingegebenen 3D-Darstellungen in einer Menge berücksichtigen.

In seiner Masterarbeit, die Paul bei senswork verfasste, implementierte er eine Methode, die Punktwolken direkt als Eingabe akzeptiert und ein neuronales Netz trainiert, das nun ein trainiertes Objekt lokalisieren kann.

Die entwickelten Tools werden in der Deep-Learning-basierten Software „Neuralyze“ von senswork implementiert.